Selbstlokalisierung

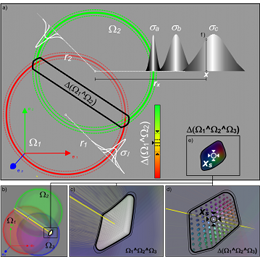

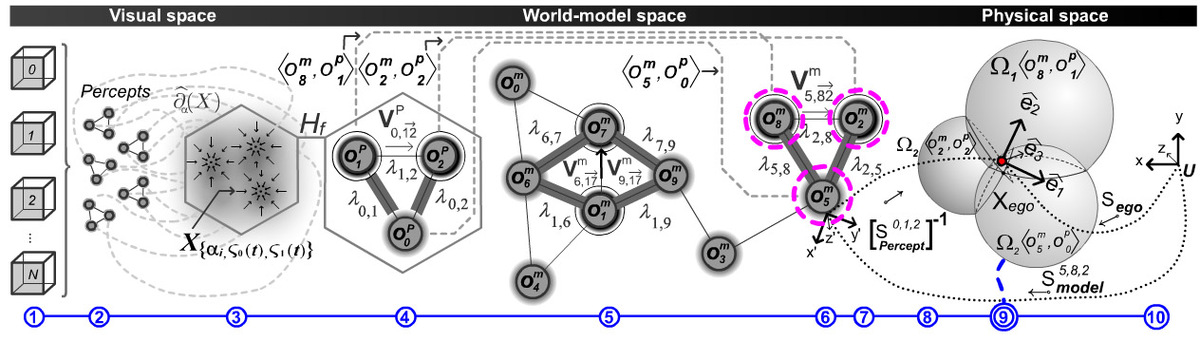

Der visuelle Wahrnehmungszyklus (Perception cycle) verbindet Realität und Umweltmodel, und spielt somit eine entscheidende Rolle bei der Selbstlokalisation Humanoider Roboter. Er verwaltet Sensoren, deren Signale und die Gewinnung wichtiger Informationen aus den Rohdaten, die dann als symbolische Instanzen im Umweltmodel repräsentiert werden. Visuelle Daten werden für den Abgleich mit dem Umweltmodell verwendet, wohingegen das Umweltmodell eine modellbasierte Segmentierung ermöglicht. Das Ziel des visuellen Wahrnehmungszyklus ist folglich möglichst robust, exakt und schnell alle notwendigen symbolischen Informationen zu erfassen, um damit Anfragen der Planungs- und Entscheidungssysteme beantworten zu können.

Die Wahrnehmung umfasst folgende grundlegende Aspekte, die jeweils stark von ihrer Echtzeitfähigkeit abhängen:

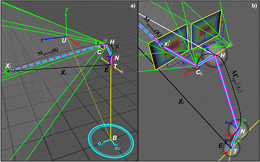

- Selbstlokalisierung (Erfassung und Verfolgung der Position und Orientierung des Roboters mithilfe aktiver stereoskopischen Sicht)

- Modellbasierte globale Lokalisierung

- Modell- und Erscheinungsbasierte dynamische Lokalisierung

- Abfrage des Zustand des Umweltmodells während der Programmausführung

- 6D Lageschätzung von Bestandteilen und Objekten der Umwelt

Das visuelle System umfasst den kompletten Arbeitszyklus zur Bewältigung komplexer Aufgaben, beginnend bei der Anfangslokalisierung, bei der visuelle Informationen zum ersten mal mit dem Umweltmodell abgeglichen wird, bis hin zur dynamischen Lokalisierung, bei der die 6D Pose des humanoiden Roboter verfolgt um das Umweltmodell zu aktualisieren. Darüber hinaus muss es in der Lage sein alle Module zu versorgen, die visuelle Informationen benötigen, wie zum Beispiel den globalen Aufgabenplaner und Entscheidungs- und Lernmechanismen.